Искусственный интеллект стремительно развивается и уже научился воздействовать на человека, вызывая у того определенные эмоции и подталкивая к заданным решениям. Опасно ли это?

Ученые из университетов Копенгагена и Хельсинки на днях объявили, что научили искусственный интеллект (ИИ) оценивать красоту человеческого лица. Для этого не потребовалось математически описывать форму глаз — компьютерному разуму просто дали возможность считывать реакцию человека через нейроинтерфейсы с помощью электроимпульсов головного мозга. ИИ сгенерировал несколько сотен портретов людей, затем изображения показали 30 добровольцам. Искусственный интеллект измерил реакцию их мозга и сделал выводы о том, что гомо сапиенс считает красивым, а что не очень.

Исследователи из австралийско-германской команды пошли дальше: дали задание искусственному интеллекту научиться влиять на принятие человеком решений. Сначала речь шла о том, на какого цвета кнопку человеку нажать. После периода самообучения ИИ научился «помогать» человеку выбирать определенную кнопку. Результативность составила 73%.

Нейросеть быстро учится распознавать алгоритм принятия решений человеком. Уже сейчас цифровые алгоритмы решают за нас, что именно показывать нам при поисковом запросе. Они собирают данные о нас из соцсетей, электронной почты, истории браузера, из показаний фитнес-браслета и GPS-датчика телефона. Предполагается, что это помогает давать нам именно ту информацию, которая нам на самом деле нужна. Но кто поручится, что ИИ не решает за нас, какая именно информация нам нужна?

Когда в США разгорелся скандал по поводу «вмешательства русских хакеров» в выборы, речь шла именно об использовании ИИ. О том, что людям в соцсетях показывалась информация, которая подталкивала их к определенному политическому решению.

Израильский историк и автор бестселлеров Юваль Ной Харари приводит в пример рекламу и поисковую выдачу. Кто поручится, что алгоритм не манипулирует нами, подталкивая к определенным решениям? ИИ знает, что нам нравится, помнит, какую информацию мы получали, когда делали покупки. Никого уже не удивляет, когда реклама в браузере на ноутбуке показывает рекламу того, что обсуждалось рядом с телефоном в другой комнате или в другом месте. А вы знаете, что уже есть технологии, позволяющие считывать и анализировать движения глаз? Так не пора ли подумать о законодательных рамках, ограничивающих использование искусственного интеллекта, вопрошает Харари. И напоминает, что Гарри Каспаров проиграл «голубой бездне» — компьютеру Deep Blue — еще в 1997 году. За 10 лет до появления первого айфона и за семь лет до создания «Фейсбука»...

Конечно, с Харари согласны далеко не все. Например, Вадим Шемаров, сооснователь цифрового сервиса Shikari.Do, в разговоре с корреспондентом «Труда» высказался так:

— С развитием ИИ справедливо возникают вопросы правового регулирования — например, в сфере беспилотного транспорта или медицины. Но что касается эмоционального и интеллектуального воздействия, то здесь законодательное регулирование излишне и даже вредно. Потому что в итоге мы получим очередную пачку невнятных законов-запретов «об оскорблении чувств».

Маркетологи, продавцы, издатели — многие пытаются воздействовать на решения человека. А разве политики не манипулировали избирателями задолго до того, как ИИ пришел в нашу реальность, вопрошает Шемаров.

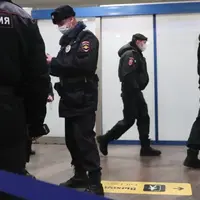

Что ж, тут действительно есть о чем поспорить. Все больше вопросов задают правозащитники — и даже добиваются ответов по существу. Так, в Калифорнии после бурной дискуссии запретили применение системы распознавания лиц в камерах наблюдения в общественных местах:

Не хотелось бы однажды проснуться и обнаружить, что мы всего лишь нажимаем кнопки, но давно не принимаем решений. За нас это делает даже не чужой дядя, а невидимый миру ИИ.